Departament Obrony Stanów Zjednoczonych (DoD) znalazł się w zaostrzającym się konflikcie z Anthropic, wiodącą firmą zajmującą się sztuczną inteligencją, w sprawie warunków kontraktu o wartości 200 milionów dolarów. Istota konfliktu? Pentagon żąda nieograniczonego dostępu do technologii Anthropic, w tym potencjalnie kontrowersyjnych zastosowań, takich jak autonomiczne systemy uzbrojenia, podczas gdy Anthropic nalega na granice etyczne – brak wewnętrznego nadzoru i w pełni zautomatyzowane maszyny do zabijania. To starcie to nie tylko spór o kod; chodzi o kontrolę, wartości i przyszłość wojskowej sztucznej inteligencji.

Ultimatum Pentagonu: Prześlij lub Anuluj

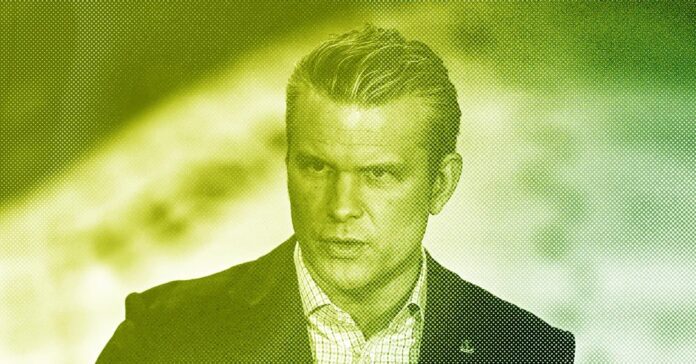

Departament Obrony pod przewodnictwem Petera Hegsetha skutecznie postawił Anthropic ultimatum: spełnić żądania do piątku lub ryzykować utratą lukratywnego kontraktu. To nie jest tylko posunięcie taktyczne w negocjacjach; to pokaz siły. Pentagon ma alternatywę – współpracuje już z xAI, firmą zajmującą się sztuczną inteligencją należącą do Elona Muska, która nie nakłada takich samych ograniczeń. ML niekoniecznie potrzebuje technologii antropicznej; chce pokazać, że firmy akceptujące rządowe pieniądze nie mogą dyktować warunków.

Jest to bezpośrednie wykorzystanie dźwigni, potencjalnie wykorzystujące ustawę o produkcji obronnej – zwykle zarezerwowaną na wypadek sytuacji kryzysowych w wojsku lub krytycznych niedoborów (takich jak produkcja masek podczas Covid) – w celu wymuszenia zgodności. Posunięcie jest agresywne, co sugeruje, że Pentagon jest bardziej zainteresowany ustanowieniem precedensu niż uzyskaniem konkretnych możliwości sztucznej inteligencji.

„Postępowa sztuczna inteligencja” i militaryzacja wartości

Retoryka Pentagonu jest prosta: nie potrzebuje „zaawansowanej sztucznej inteligencji”. Nie chodzi tu o specyfikacje techniczne; mówimy o dostosowaniu ideologicznym. Departament Obrony chce sztucznej inteligencji, która działa bez „ograniczeń ideologicznych”, to znaczy bez ograniczeń etycznych w zastosowaniach wojskowych. To jasny komunikat dla branży technologicznej: jeśli chcesz kontraktów w dziedzinie obronności, musisz być skłonny przedłożyć efektywność operacyjną nad względy moralne.

Sytuacja podkreśla szerszą tendencję: rządy w coraz większym stopniu przejmują kontrolę nad rozwojem sztucznej inteligencji, odpychając się od firm, które próbują narzucać ograniczenia wartości. To nie jest nowa walka. Administracja Trumpa napotkała podobny opór, ale firmy technologiczne w dużej mierze zastosowały się do jego zaleceń. Potencjalna porażka Anthropic może zakłócić ten schemat.

Osiągnięcia i naśladowcy dzielą się w Dolinie Krzemowej

Tymczasem Dolinę Krzemową ogarnęła nowa obsesja: ustalanie, czy ludzie są „chętni”, czy „chcący”. Cele są określane jako zdecydowane, zorientowane na działanie i posiadające motywację. Naśladowcy są ostrożni, współpracują i czekają, aż inni przejmą inicjatywę. Model ten jest obecnie stosowany przy zatrudnianiu w laboratoriach sztucznej inteligencji, przy założeniu, że aspirujący odniosą sukces w świecie zdominowanym przez sztuczną inteligencję, a naśladowcy pozostaną w tyle.

Tendencja ta jest zasadniczo zaawansowanym technologicznie testem osobowości. Odzwierciedla niepokój związany z automatyzacją i zmieniającym się charakterem pracy. Pytanie nie brzmi, jak dokładne są te etykiety; chodzi o to, że pokazują, jak Dolina Krzemowa ceni wartość człowieka w dobie sztucznej inteligencji.

Kable podmorskie i dziedzictwo infrastruktury

Tymczasem podmorski kabel TAT-8, istotne ogniwo wczesnej infrastruktury internetowej, został wyłączony z eksploatacji. Choć mniej dramatyczny niż konflikt sztucznej inteligencji, jego zakończenie przypomina nam o fizycznych podstawach cyfrowego świata. Kable te były niezbędne dla globalnej komunikacji, ale obecnie są przestarzałe.

Przypomina to, że technologia składa się z warstw — oprogramowanie zależy od sprzętu, a sprzęt od infrastruktury fizycznej. Historia kabla TAT-8 to ciche ostrzeżenie: nawet najbardziej niezawodne systemy w końcu stają się przestarzałe, a innowacja wymaga ciągłego dostosowywania.

Podsumowując, spór między Anthropic a Pentagonem nie dotyczy wyłącznie etyki sztucznej inteligencji; to próba siły i kontroli. Obsesja na punkcie cech „przebojowego” w Dolinie Krzemowej odzwierciedla głębsze obawy dotyczące automatyzacji i wartości ludzkiej. Wycofanie kabla TAT-8 z eksploatacji uwydatnia ulotny charakter nawet najbardziej niezbędnych technologii. Przyszłość nadchodzi i te wydarzenia kształtują jej warunki.