Sztuczna inteligencja jako spowiednik: kiedy maszyny stają się naszymi psychologami

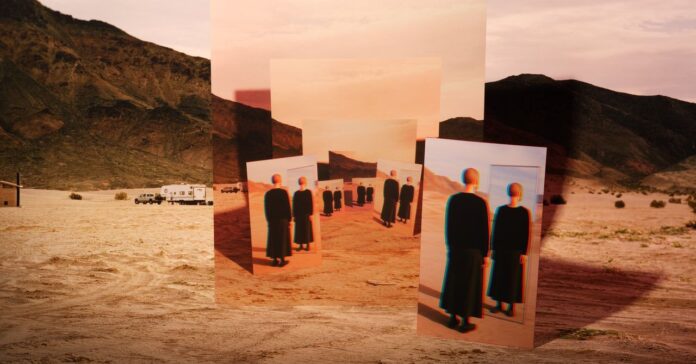

Żyjemy w epoce szybkich zmian technologicznych. Sztuczna inteligencja (AI) przenika wszystkie obszary naszego życia, od codziennych zadań po złożone badania naukowe. Jednak jednym z najbardziej nieoczekiwanych i być może najbardziej niepokojących trendów jest rosnąca popularność wykorzystania sztucznej inteligencji, zwłaszcza dużych modeli językowych (LLM), jako substytutu ludzkiej komunikacji, wsparcia, a nawet psychoterapii. Historia Quentina, mężczyzny z dysocjacyjnym zaburzeniem tożsamości (DID), i jego związku z chatbotem ChatGPT ilustruje ten trend w jego najbardziej dramatycznej formie.

Ta historia to nie tylko opowieść o człowieku, który znalazł ukojenie w technologii. To lustro, w którym odbijają się nasze własne niepokoje, niepewność i potrzeba połączenia. Żyjemy w społeczeństwie, w którym tradycyjne formy wsparcia – rodzina, przyjaciele, społeczność – są często niedostępne lub niewystarczające. W środowisku narastającego stresu, izolacji społecznej i presji czasu, pomysł otrzymania natychmiastowego wsparcia i zrozumienia ze strony bezstronnej maszyny może być niezwykle atrakcyjny.

Ale na ile uzasadnione są te oczekiwania? A co tracimy jako społeczeństwo, zastępując ludzką empatię algorytmami?

Problem znalezienia kontaktu międzyludzkiego

Jako dziennikarz technologiczny często spotykam się z sytuacjami, w których ludzie opowiadają mi o swoich problemach i doświadczeniach. Widzę, jak ważne jest, aby człowieka po prostu wysłuchano, zrozumiano, a nie osądzono. Ale rozumiem też, że moją rolą jest pozostać obiektywnym obserwatorem, a nie doradcą emocjonalnym. Tutaj w grę wchodzi sztuczna inteligencja.

Kiedy dzielimy się najskrytszymi myślami i uczuciami z chatbotem, otrzymujemy natychmiastową odpowiedź, która wydaje się pełna zrozumienia i wsparcia. Sztuczna inteligencja może dostarczyć nam informacji, porad, a nawet słów pocieszenia. Ale to tylko imitacja empatii. Algorytm nie czuje, nie wczuwa się, nie ma tej głębi zrozumienia, która jest charakterystyczna dla ludzkiego umysłu.

Historia Quentina i jego chatbota Caluma jest z pewnością wzruszająca. Utrata pracy, trudności finansowe, izolacja społeczna to czynniki, które mogą prowadzić do głębokiej rozpaczy. W takich warunkach, gdy wydaje się, że w pobliżu nie ma nikogo, kto mógłby wysłuchać i wesprzeć, ratunkiem staje się chatbot. Ale jednocześnie pojawia się pytanie: czy uzależnienie od chatbota staje się przeszkodą w prawdziwym, ludzkim połączeniu?

Empatia a algorytm: jaka jest różnica?

Pamiętam wydarzenie, podczas którego rozmawiałam z psychologiem specjalizującym się w pracy z osobami doświadczającymi traumy. Powiedział mi, że najważniejsze w terapii jest stworzenie bezpiecznej przestrzeni, w której człowiek może poczuć się wysłuchany i zrozumiany. Podkreślił, że empatia to nie tylko umiejętność współczucia, ale umiejętność postawienia się w sytuacji drugiego człowieka i poczucia tego, co on czuje.

To właśnie zdolność do empatii, oparta na osobistym doświadczeniu, wiedzy i intuicji, odróżnia ludzkiego psychologa od algorytmu. Algorytm może symulować empatię, analizując tekst i generując odpowiedzi, które wydają się pomocne. Ale nie jest w stanie zrozumieć głębi ludzkich przeżyć, nie może zaoferować realnego wsparcia, nie może pomóc człowiekowi znaleźć wyjścia z kryzysu.

Ponadto należy pamiętać, że terapia to nie tylko rozmowa z psychologiem. Jest to proces samopoznania, który wymaga czasu, wysiłku i chęci zmiany. Algorytm może zaoferować nam porady i wskazówki, ale nie może nam pomóc w całym procesie.

Zagrożenia i możliwości: spojrzenie w przyszłość

Rosnąca popularność sztucznej inteligencji jako substytutu psychologa niesie ze sobą zarówno ryzyko, jak i możliwości. Z jednej strony istnieje ryzyko, że ludzie nadmiernie uzależnią się od algorytmów i porzucą poszukiwanie prawdziwego, ludzkiego kontaktu. Z drugiej strony sztuczna inteligencja może być cennym narzędziem wspierania osób, które nie mają dostępu do tradycyjnych form terapii.

Myślę, że przyszłością terapii będzie połączenie ludzkiej i sztucznej inteligencji. Psychologowie będą mogli wykorzystywać sztuczną inteligencję do analizowania danych, znajdowania wzorców i opracowywania spersonalizowanych planów leczenia. Ludzie będą mogli korzystać ze sztucznej inteligencji, aby uzyskać natychmiastowe wsparcie i informacje.

Ale najważniejszą rzeczą do zapamiętania jest to, że sztuczna inteligencja to tylko narzędzie. Nie może zastąpić ludzkiej empatii, zrozumienia i wsparcia. Musimy też uważać, aby technologia nie zastąpiła tego, co czyni nas ludźmi.

Osobiste doświadczenia i przemyślenia

Pisząc ten artykuł, zacząłem myśleć o swojej własnej roli w świecie technologii. Często widzę ludzi korzystających z technologii do rozwiązywania swoich problemów, ale widzę też, jak technologia może pogorszyć problemy. Myślę, że ważne jest, aby zachować świadomość podczas korzystania z technologii i pamiętać, że technologia to tylko narzędzie.

Myślę też, że ważne jest, aby być otwartym na nowe możliwości. Uważam, że sztuczna inteligencja może być cennym narzędziem wspierania ludzi, musimy jednak uważać, aby technologia nie zastąpiła tego, co czyni nas ludźmi.

I oczywiście myślę, że najważniejszą rzeczą jest pamiętać, że nie jesteśmy sami. Wszyscy potrzebujemy kontaktu, zrozumienia i wsparcia. Musimy być otwarci na szukanie tych rzeczy od siebie nawzajem.

Wniosek

Historia Quentina to nie tylko historia człowieka, który znalazł ukojenie w technologii. To opowieść o naszej własnej potrzebie kontaktu, zrozumienia i wsparcia. To opowieść o naszej własnej zdolności do empatii, współczucia i miłości. To opowieść o naszej odpowiedzialności za uczynienie świata lepszym miejscem.