Il Dipartimento della Difesa degli Stati Uniti (DOD) è bloccato in una situazione di stallo crescente con Anthropic, una delle principali società di intelligenza artificiale, sui termini di un contratto da 200 milioni di dollari. Il problema principale? Il Pentagono vuole un accesso illimitato alla tecnologia AI di Anthropic, anche per applicazioni potenzialmente controverse come i sistemi di armi autonome, mentre Anthropic insiste su confini etici: nessuna sorveglianza domestica o macchine per uccidere completamente automatizzate. Questo scontro non riguarda solo il codice; riguarda il controllo, i valori e il futuro dell’intelligenza artificiale militare.

L’ultimatum del Pentagono: conformità o cancellazione

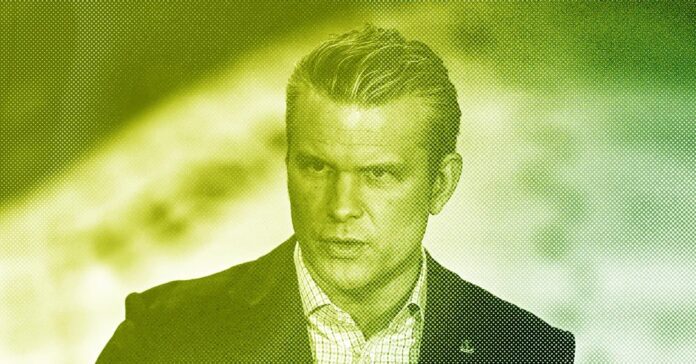

Il DOD, sotto il segretario Pete Hegseth, ha sostanzialmente lanciato ad Anthropic un ultimatum: ottemperare alle loro richieste entro venerdì, o rischiare di perdere il lucroso contratto. Questa non è solo una tattica di negoziazione; è un gioco di potere. Il Pentagono ha delle alternative: ha già collaborato con xAI, l’impresa AI di Elon Musk, che non impone le stesse restrizioni. Il DOD non ha necessariamente bisogno della tecnologia di Anthropic; vuole dimostrare che le aziende che accettano denaro pubblico non possono dettare termini.

Si tratta di una schietta dimostrazione di potere, che potenzialmente invoca il Defense Production Act – tipicamente riservato alle emergenze in tempo di guerra o alle carenze critiche (come la produzione di mascherine durante Covid) – per imporre la conformità. La mossa è aggressiva, suggerendo che il Pentagono si preoccupa più di creare un precedente che di specifiche capacità dell’intelligenza artificiale.

“Woke AI” e l’arma dei valori

La retorica del Pentagono è mirata: non vuole “l’IA svegliata”. Non si tratta di prestazioni tecniche; si tratta di allineamento ideologico. Il DOD vuole un’intelligenza artificiale che operi senza “vincoli ideologici”, ovvero senza limitazioni etiche sulle sue applicazioni militari. Ciò segnala un messaggio chiaro all’industria tecnologica: se vuoi contratti per la difesa, devi essere disposto a dare priorità all’efficacia operativa rispetto alle preoccupazioni morali.

La situazione evidenzia una tendenza più ampia: i governi stanno affermando sempre più il controllo sullo sviluppo dell’intelligenza artificiale, respingendo le aziende che tentano di imporre restrizioni basate sui valori. Questa non è una nuova battaglia. L’amministrazione Trump ha riscontrato una resistenza simile, ma le aziende tecnologiche in generale si sono allineate. Il potenziale rifiuto di Anthropic potrebbe rompere questo schema.

Il divario agentico vs. mimetico nella Silicon Valley

Nel frattempo, la Silicon Valley è consumata da una nuova ossessione: identificare se gli individui sono “agenti” o “mimetici”. Le persone agentiche sono descritte come decise, orientate all’azione e guidate da sé. Gli individui mimetici sono cauti, collaborativi e aspettano che siano gli altri a guidare. Questo quadro viene ora utilizzato nelle assunzioni nei laboratori di intelligenza artificiale, con il presupposto che i tipi di agenti prospereranno in un futuro dominato dall’intelligenza artificiale, mentre quelli mimetici rimarranno indietro.

Questa tendenza è essenzialmente un test della personalità ad alta tecnologia. Riflette le ansie sull’automazione e sulla natura mutevole del lavoro. La domanda non è se le etichette siano accurate; è che rivelano come la Silicon Valley vede il valore umano nell’era dell’intelligenza artificiale.

I cavi sottomarini e l’eredità delle infrastrutture

Passando ad altre notizie, il cavo sottomarino TAT-8, un collegamento vitale nella prima infrastruttura Internet, è stato smantellato. Anche se meno drammatica della faida contro l’intelligenza artificiale, la sua fine ci ricorda le basi fisiche del mondo digitale. Questi cavi erano essenziali per la connettività globale, ma ora sono obsoleti.

Questo ci ricorda che la tecnologia è costruita su livelli: il software si basa sull’hardware e l’hardware si basa sull’infrastruttura fisica. La storia del cavo TAT-8 è un avvertimento silenzioso: anche i sistemi più durevoli prima o poi svaniscono e l’innovazione richiede un adattamento costante.

In conclusione, lo stallo tra Anthropic e il Pentagono non riguarda solo l’etica dell’IA; è una prova di potere e controllo. L’ossessione per i tratti “agentici” nella Silicon Valley riflette paure più profonde sull’automazione e sulla rilevanza umana. E lo smantellamento del cavo TAT-8 sottolinea la natura transitoria anche delle tecnologie più essenziali. Il futuro sta arrivando e questi eventi ne stanno modellando i termini.